Bestimmtheitsmaß R² - Teil 3: Die Varianzzerlegung

Das R² ist ein Gütemaß der linearen Regression (s. Teil 1 und Teil 2 der Artikelserie über das Bestimmtheitsmaß). Ein wichtiges Konzept zum Verstehen des Bestimmtheitsmaß R² ist die Varianzzerlegung.

Allein unter Kenntnis der gemessenen Größe y ist die naivste Vorhersage bzw. Schätzung für eine neue Beobachtung yi, die man anstellen kann, der Mittelwert eben jener Größe ȳ (i bezeichnet in diesem Fall eine spezielle Beobachtung). Die Varianz einer Variablen beschreibt in diesem Sinne die Abweichungen der Beobachtungen vom Mittelwert. Durch Hinzunahme einer oder mehrerer unabhängiger Variablen können wir die Vorhersage der abhängigen Variablen verbessern, indem das Wissen um den Zusammenhang eben dieser Variablen mit y in die Prognose einbezogen wird. Es resultiert eine neue Regressionsgerade, die den wahren Beobachtungen näher kommt. Trotzdem bleibt in der Praxis immer ein Rest an Varianz, der auch durch die unabhängigen Variablen nicht erklärt werden kann. Die Abweichung einer Beobachtung von der Regressionsgeraden nennt sich Fehler bzw. Residuum ei.

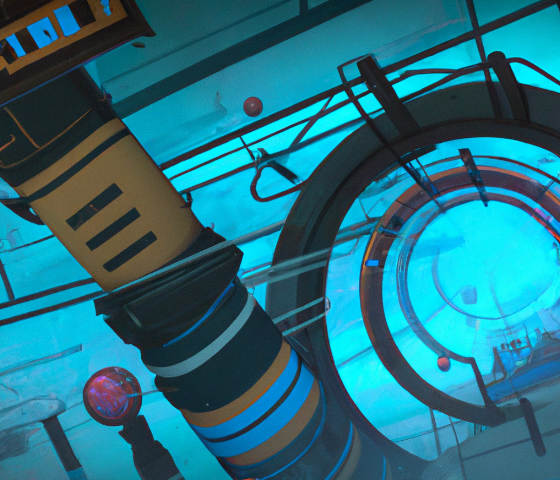

Die folgende Grafik veranschaulicht dieses Konzept anhand einer einfachen Regression:

Die blauen Punkte stellen die gemessene Größe yi dar, die horizontale Linie kennzeichnet den Mittelwert ȳ der abhängigen Variablen und die geneigte Linie veranschaulicht die durch das Modell bzw. die unabhängige Variable vorhergesagten Werte ŷ.

- Die vertikale orangene Linie gibt die Gesamtabweichung einer beispielhaft ausgewählten Beobachtung yi zum Mittelwert ȳ an – diesen Fehler würden wir machen, wenn wir mit dem Mittelwert ȳ die entsprechende Beobachtung yi vorhersagen würden.

- Erklärte Abweichung: Die vertikale blaue Linie kennzeichnet die Abweichung der Regressionsgeraden zum Mittelwert – diesen Fehler können wir durch Hinzunahme der unabhängigen Variablen x vermeiden.

- Unerklärte Abweichung/Residuum: Die vertikale rote Linie gibt die Abweichung der speziellen Beobachtung yi zur Regressionsgeraden an (Residuum ei) – diesen Teil der Abweichung können wir auch durch Hinzunahme der unabhängigen Variablen x nicht vermeiden. Dabei ist zu beachten, dass die Residuen zufällig um die Regressionsgerade streuen sollten. Tun sie das nicht, ist von einer Fehlspezifikation des Modells auszugehen.

Das Prinzip der Varianzzerlegung spiegelt sich auch in der Formel zur Berechnung des R² wider:

oder

wobei n die Anzahl der Beobachtungen ist.

Fazit

Die naivste Vorhersage eines Merkmals für eine bestimmte unbekannte Beobachtung ist der Mittelwert über das Merkmal aller vorhandenen Beobachtungen. Die Nutzung der Information aus zusätzlichen (unabhängigen) Variablen im Rahmen eines Regressionsmodells kann helfen, diese Schätzung zu verfeinern und somit genauere Vorhersagen (Prognosen) zu treffen. Diese Verbesserung des Modells lässt sich am Bestimmtheitsmaß R² festmachen. Allerdings stimmen vorhergesagter Wert und beobachteter Wert in den seltensten Fällen exakt überein. In der Praxis bleibt immer eine Restabweichung des Punktes von der Regressionsgeraden – das Residuum. Bei einer korrekten Spezifikation des Modells sollten die Residuen zufällig um die Regressionsgerade streuen. Das R² nutzt das Konzept der Varianzzerlegung. Es besagt, dass sich die Varianz der abhängigen Variablen in erklärte Varianz und nicht erklärte Varianz (Residualvarianz) zerlegen lässt.